啟動成功關鍵,隨時掌握商周.com最新資訊

提供第一手新聞解析、財經趨勢、專屬活動

啟動成功關鍵,隨時掌握商周.com最新資訊

提供第一手新聞解析、財經趨勢、專屬活動

本文獲科技報橘 授權刊登,原文出處

授權刊登,原文出處

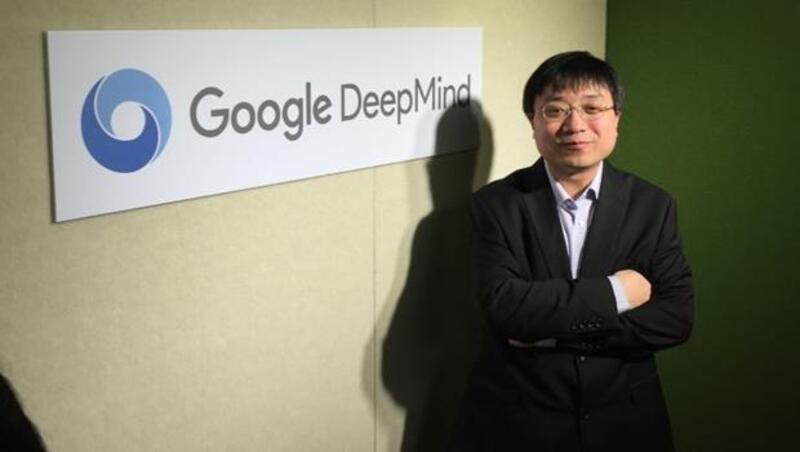

Google人工智慧 AlphaGo在圍棋賽中以4:1的成績打敗南韓九段棋王李世乭,代表機器深度學習進展里程碑,而背後程式主要開發的開發者,就是來自台灣的師大博士黃士傑。身為「AlphaGo 之父」,黃士傑在這場「全世界都關注」的人機大賽中,同樣代表了台灣人才在技術領域上的卓越成就。

Google 台灣邀請這次 AlphaGo 的主要開發者之一、比賽執棋者黃士傑,針對機器深度學習的原理,以及就比賽歷程做分享。黃士傑表示:「我在師大學習的論文,成為我做出 AlphaGo的基礎。」,並且表示,台灣人才其實很優秀,但一方面資源較少,更缺乏信心,例如害怕英文不好無法與外籍人士溝通。他當初剛到國外上班時,也花了很大時間訓練聽力,但是這些外在因素都不影響他在技術上的傑出表現,鼓勵台灣開發者人才應該勇敢走出去。

黃士傑在Google旗下的人工智慧公司「DeepMind」擔任資深研究員。DeepMind目前員工約200多名,其中便有4名台灣人在裡面貢獻所長。裡面員工來自世界各地,大家都在技術、表現上有強烈的企圖心。這其實也給台灣人一個啟示,黃士傑說:「我們(台灣人)其實不弱,但就是要走出去。」

其實,不只一次台灣人才在機器學習、人工智慧的領域上成就亮眼。例如新創團隊 Appier便是用人工智慧技術,投入廣告產業;台大教授洪士灝也曾說過,台灣其實擁有世界需要的人工智慧人才,但是能否將這些人才變成專業研發團隊,才是台灣未來考驗。

這次,AlphaGo在圍棋技藝上的驚人成就,更是大眾焦點。到底,機器是如何超越人腦取勝的?根據黃士傑的分享,AlphaGo基本上就是機器的深度學習。這套系統仰賴兩套網路:策略網路(Policy Nets)、價值網路(Value Nets)。價值網路負責判斷賽局,搜尋哪方佔優勢關鍵;策略網路則可判斷最佳棋路,類似人類用直覺下棋。

AlphaGo透過學習20、30萬套棋譜,將棋譜知識整合分析後,內化成 AlphaGo的知識,並且在系統內日以繼夜的與自己下棋,增進棋藝,這也稱強化式學習(reinforcement learning )。透過兩套網路的搭配使用,讓AlphaGo的棋藝可以大幅提伸。

在唯一一場 AlphaGo落敗的比賽中,黃士傑也表示,團隊目前還在查詢原因,或許是價值網路出現Bug因而產生誤判,而不是外界所傳聞的故意讓棋。未來,AlphaGo的技術將會被應用在醫療領域,例如利用融合大量醫療病例,為未來的問診做出醫學診斷。

而至於是否會使用AlphaGo挑戰其他旗手,或是其他遊戲,黃世傑表示團隊仍在考慮中。

TechOrange,專門追蹤全球網路產業的科技網誌。提供網路創業者、行銷人員、媒體人員關於網路的資訊與知識是我們的任務。文章輕薄短小,吸收科技新知沒負擔,每天大概花吃顆橘子的時間來瀏覽就夠了。

TechOrange,專門追蹤全球網路產業的科技網誌。提供網路創業者、行銷人員、媒體人員關於網路的資訊與知識是我們的任務。文章輕薄短小,吸收科技新知沒負擔,每天大概花吃顆橘子的時間來瀏覽就夠了。

畫重點

畫重點

段落筆記

段落筆記

作者簡介_科技報橘

作者簡介_科技報橘